SOFS auf Basis eines Storage Spaces Direct Cluster unter Windows Server 2019

In den letzten Wochen habe ich mich mit dem Thema „Hyper Converged Infrastruktur“ und „Converged Infrastruktur“ unter dem Windows Server 2019 beschäftigt.

In diesem Blog zeige ich, wie ein „SOFS Cluster“ (Scale-Out-File-Server) auf der Basis von „Storage Spaces Direct Cluster“ bereitgestellt wird. Ich habe mich für ein 2 Node Szenarion mit einem einfachen 2-Way-Mirror entschieden. In einer Produktivenumgebung würde ich persönlich Minimum 3 Nodes besser 4 Nodes bevorzugen.

Wie so immer im Leben, da wo Licht ist, gibt es auch Schatten, denn die Konfiguration ist schon sehr umfangreich. 🙂

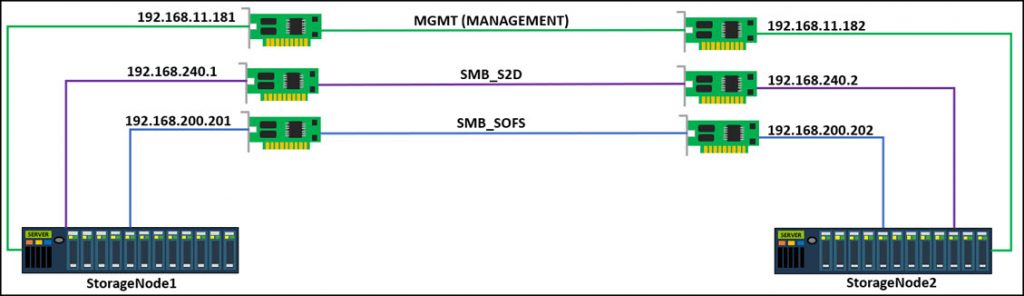

Schaubild

Im Nachfolgende Schaubild wird die Netzwerk-Konfiguration dargestellt.

Voraussetzungen

- StorageNode1 und StorageNode2 sollten auf dem selben Betriebssystem-Level wie „Windows Server 2019“ und auch Patch-Level sein

- StorageNode1 und StorageNode2 sind Mitglied der Domäne.

- Beide Nodes verfügen über jeweils 5 HDDs für den StorageSpace Direct Cluster

- Beide Nodes verfügen über jeweils 3 Netzwerkkarten (siehe Schaubild)

- Nutzen Sie die Namen MGMT, SMB_S2D und SMB_SOFS für die Netzwerkkarten

- Administrationsberechtigungen auf StorageNode1 und StorageNode2 und in der Domäne sowie im DNS

- Ein FileShare als „Quorum“ wird auf einem File Server benötigt

[BoxHaftung]

Installation und Konfiguration des Clusters

1. Melden Sie sich via „RDP“ Remotedesktop an dem StorageNode1 an und führen den nachfolgenden Powershell Befel aus, um den „Failover-Cluster“ zu installieren.

Install-WindowsFeature –Name File-Services, Failover-Clustering –IncludeManagementTools2. Wiederholen Sie diesen Schritt ebenfalls auf dem StorageNode2

3. Führen Sie den Cluster-Validierungs-Test vom StorageNode1 durch, indem Sie den nachfolgenden Powershell Befehl ausführen.

Test-Cluster –Node "StorageNode1","StorageNode2" –Include “Storage Spaces Direct”,"Inventory","Network",”System Configuration”4. Im nächsten Schritt werden StorageNode1 und StorageNode2 zu einem Failover Cluster zusammengeführt. Führen Sie hierzu den nachfolgenden Powershell Befehl vom StorageNode1 aus.

New-Cluster –Name "S2DSOFS" –Node "StorageNode1","StorageNode2" –NoStorage -StaticAddress "192.168.11.1835. Setzten Sie das Quorum für den Cluster mit dem nachfolgenden Powershell Befehl.

[BoxHinweis] Ich gehe davon aus, dass das Share für das Quorum bereits angelegt ist [/BoxHinweis]

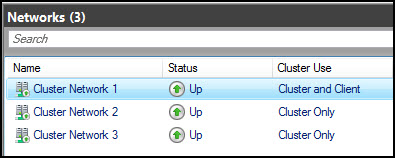

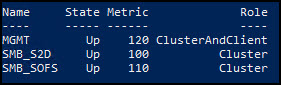

Set-ClusterQuorum -FileShareWitness "\\srv001.corp.id-home.de\S2DQuorum"6. Bennen Sie die Cluster Netzwerke 1-3 um, nutzen Sie die nachfolgenden Powershell Befehle dazu.

(Get-ClusterNetwork -Name "Cluster Network 1").Name = "MGMT"

(Get-ClusterNetwork -Name "Cluster Network 2").Name = "SMB_S2D"

(Get-ClusterNetwork -Name "Cluster Network 3").Name = "SMB_SOFS"7. Setzten Sie nun die Cluster Metrik für den Cluster

(Get-ClusterNetwork "SMB_S2D").Metric = 100

(Get-ClusterNetwork "SMB_SOFS").Metric = 110

(Get-ClusterNetwork "MGMT").Metric = 1208. Prüfen Sie ihre Einstellungen mit dem Befehl „Get-ClusterNetwork“

Installation und Konfiguration S2D Storage Spaces Direct

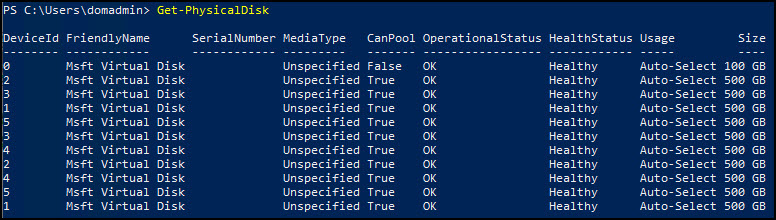

1. Melden Sie sich an den „StorageNode1“ an und prüfen, ob alle physikalischen Disk vorhanden sind. Nutzen Sie hierfür den nachfolgenden Powershell Befehl.

Get-PhysicalDisk

In der Spalte „CanPool“ wird Ihnen angezeigt welche Disks zum „Storage Spaces Pool“ hinzugefügt werden können.

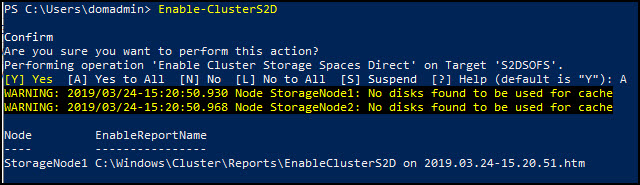

2. Aktivieren Sie Storage Spaces mit dem nachfolgenden Powershell Befehl.

Bestätigen Sie die Rückfrage mit „A“ für „Yes to All“

Enable-ClusterS2D

Die Disks wurden automatisch zum Storage Pool hinzugefügt und ein „Zwei-Wege-Mirror“ wurde angelegt.

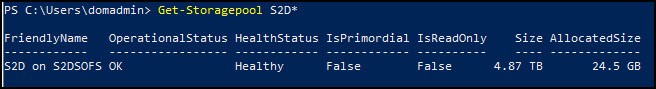

3. Führen Sie den nachfolgen Powershell Befehl aus um sich den Pool anzeigen zu lassen.

Get-Storagepool S2D*

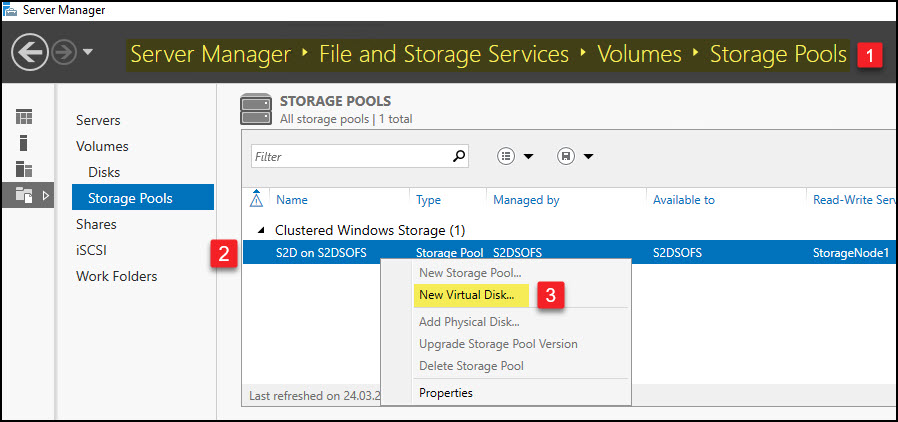

4. Starten Sie den ServerManager und selektieren „Storage Pools“

Klicken Sie mit der rechten Maustaste auf den S2D Cluster und selektieren „New Virtual Disk“

(siehe nachfolgenden Screenshot)

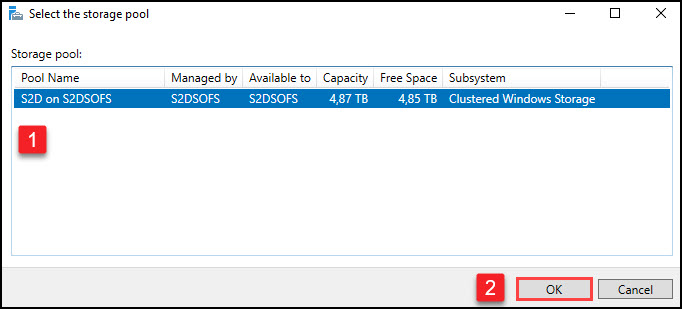

5. Selektieren Sie den Storage Pool und klicken auf „OK“

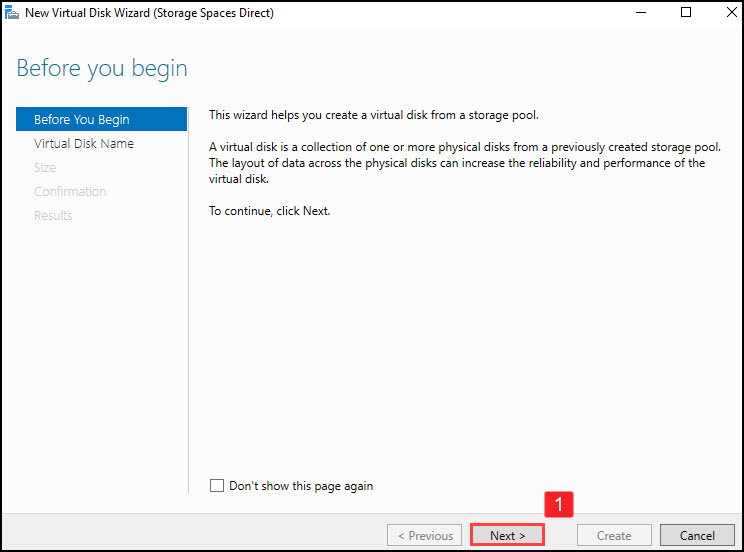

6. Klicken Sie im „Virtual Disk Wizard“ auf „Next“

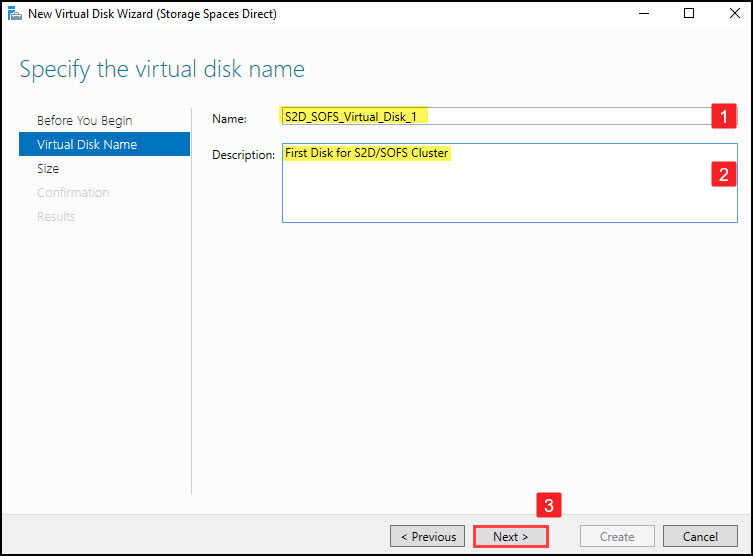

7. Vergeben Sie einen Namen und eine Beschreibung für die Virtual Disk

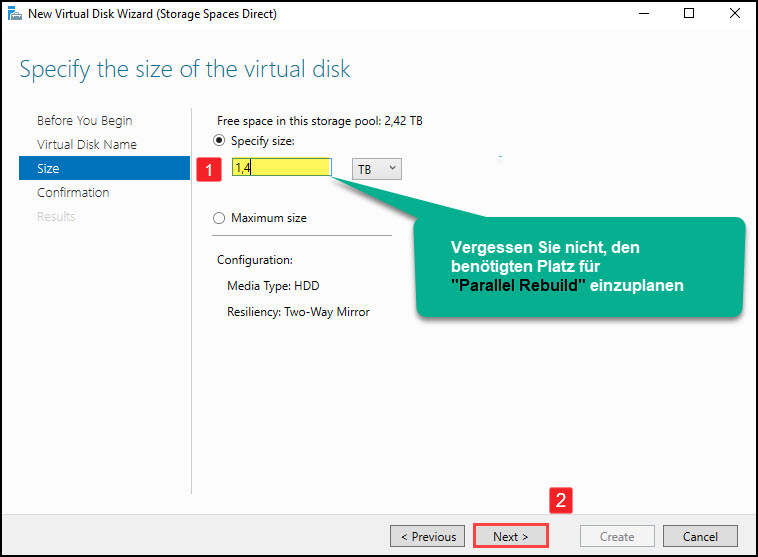

8. Geben Sie die Größe der Disk an und klicken auf „NEXT“

[BoxHinweis]Wenn Sie „PARRALEL REBUILD“ nutzen möchten, dann müssen Sie die nachfolgenden Spezifikationen beachten.

2-node Cluster: benötigt nicht genutzten Platz für „2 capacity devices“

3-node Cluster: benötigt nicht genutzten Platz für „3 capacity devices“

4-node Cluster und mehr: benötigt nicht genutzten Platz für „4 capacity devices“

In meinem Beispiel lasse ich somit 2 x 500GB frei, da jede Disk 500GB Kapazität hat und ich einen 2 Node Cluster betreibe. [/BoxHinweis]

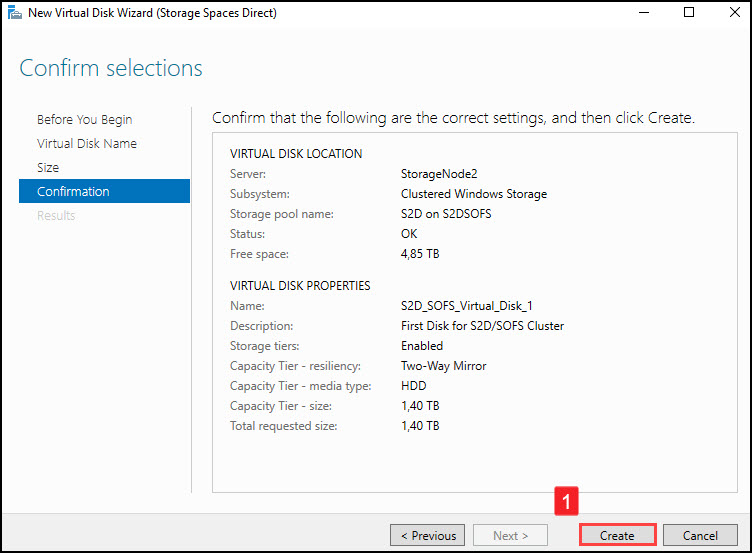

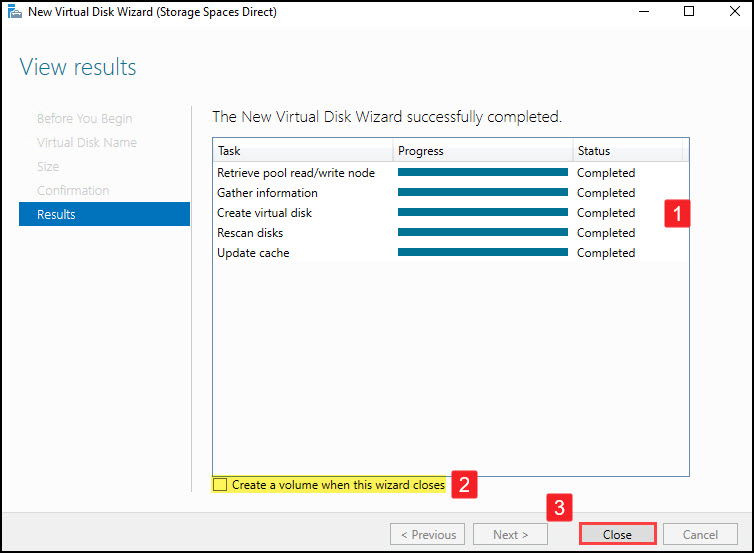

9. Klicken Sie auf „Create“ um die Virtuelle Disk zu erstellen.

10. Folgen Sie den nachfolgenden Screenshot und bestätigen Sie den Dialog mit „Close“

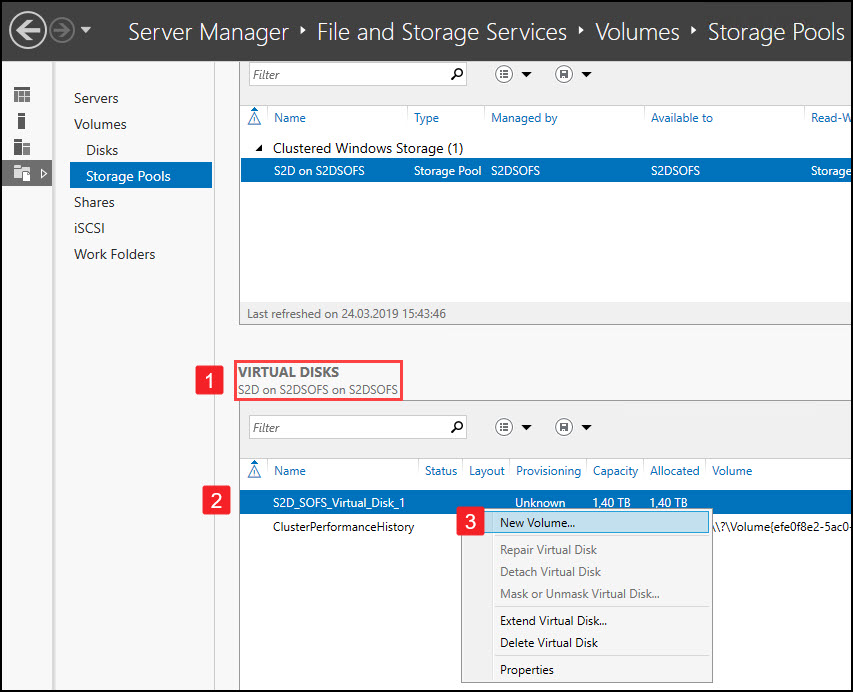

11. Legen Sie nun über den ServerManager ein „Volume“ an

(siehe nachfolgenden Screenshot)

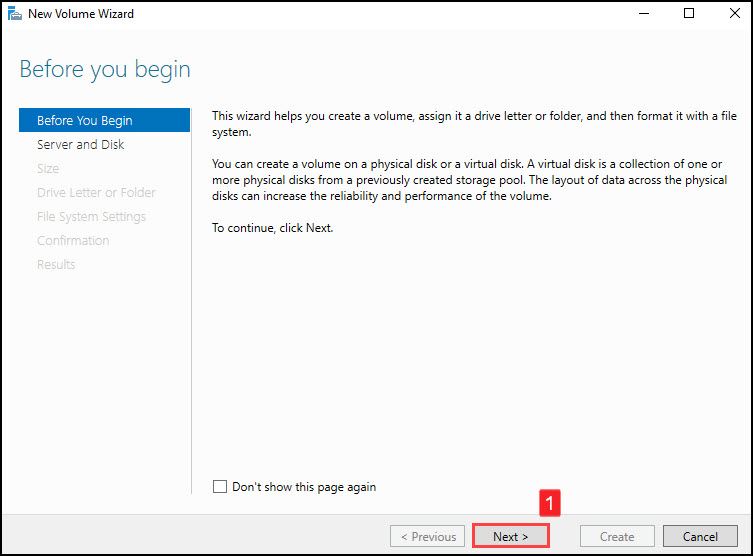

12. Klicken Sie auf „NEXT“

13. Selektieren Sie die Virtual Disk, die Sie zuvor erstellt haben, und klicken auf „NEXT“

(siehe Screenshot)

14. Klicken Sie auf „NEXT“

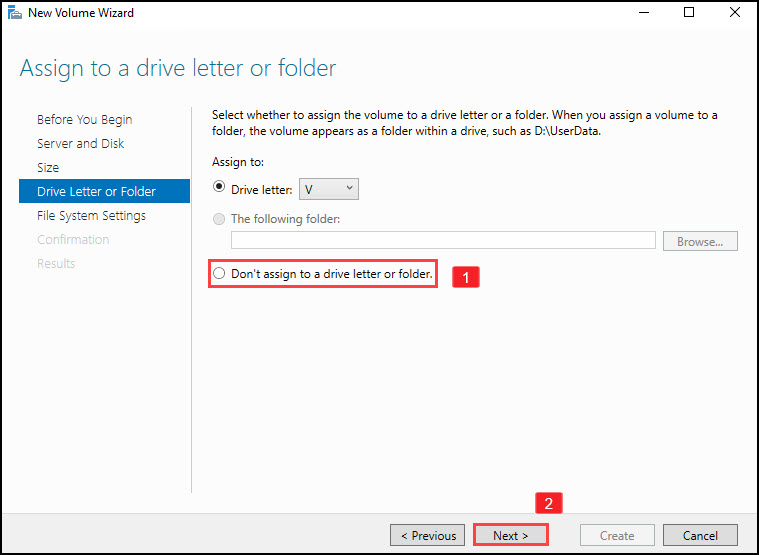

15. Selektieren Sie „Don’t assign to a drive letter or Folder“ und fahren fort indem Sie auf „NEXT“ klicken.

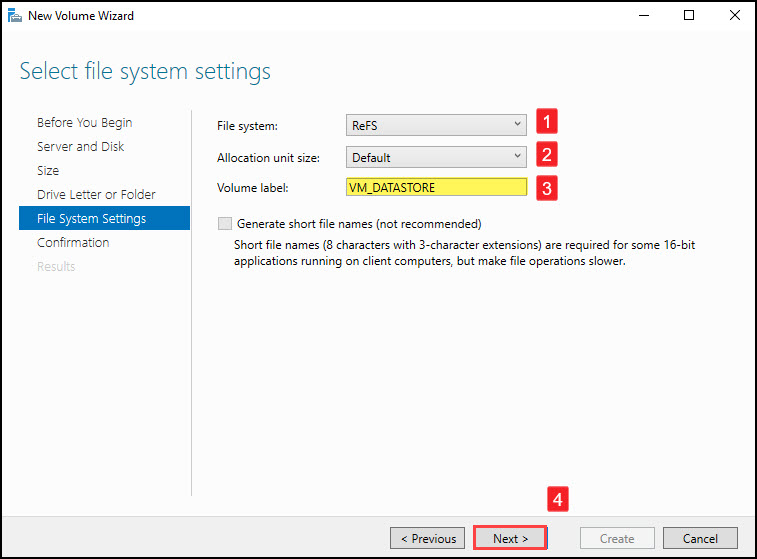

16. Formatieren Sie das Volume mit „ReFS“ und vergeben ein „Volume label“

Klicken Sie im Anschluss auf „NEXT“

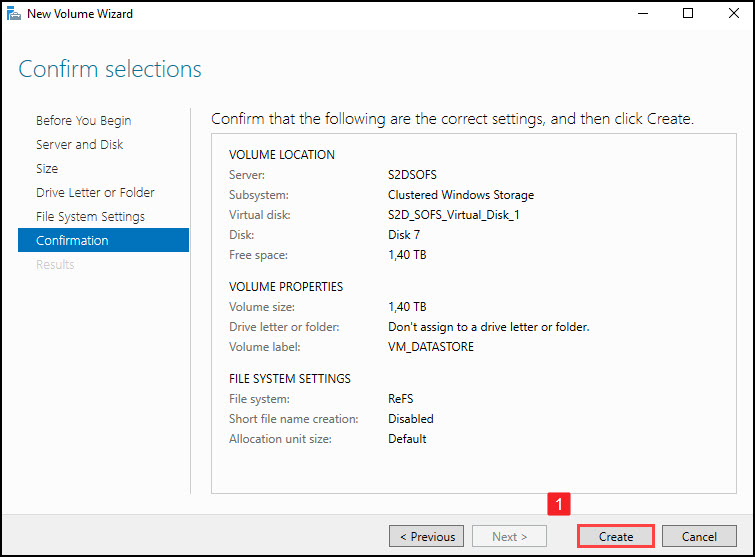

17. Bestätigen Sie den nachfolgenden Dialog mit „Create“ um das Volume zu erstellen

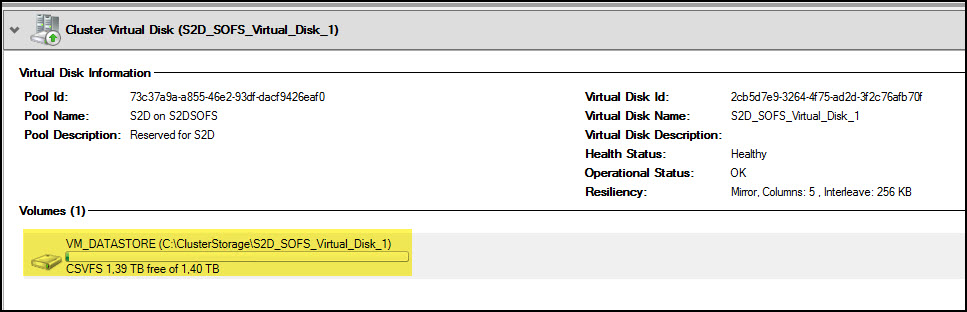

18. Sie Sollten nun im „Cluster Failover Manager“ das Volume wieder finden

(siehe Screenshot)

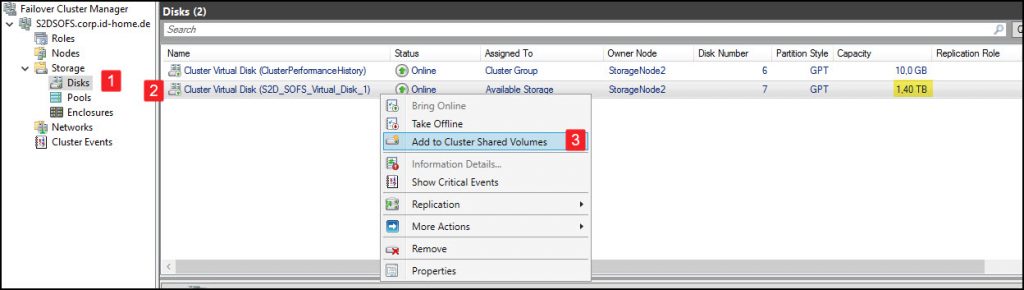

19. Fügen Sie das Volume zu den „Cluster Shared Volumes“ hinzu. (siehe Screenshot)

Die Installation und Konfiguration des Storage Spaces Direct Clusters ist abgeschlossen. Im nächsten Schritt wird dem Cluster die „SOFS Scale-Out-File-Server“ Rolle zugewiesen

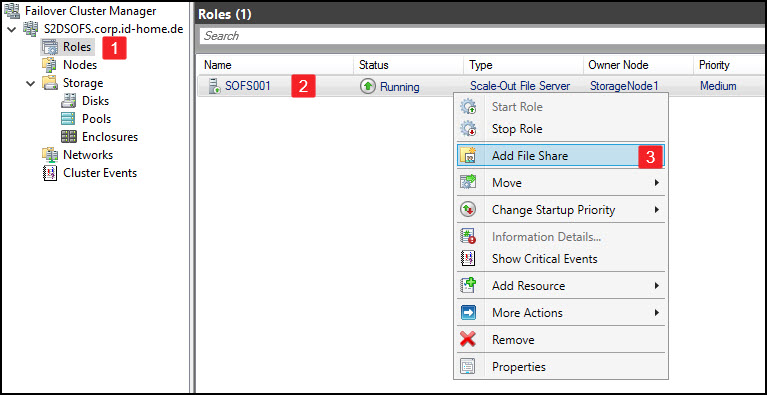

Installation und Konfiguration SOFS

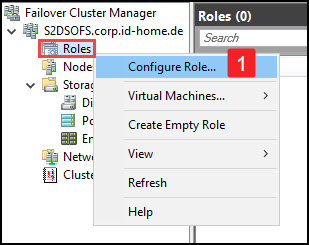

1. Klicken Sie mit einem Rechtsklick im „Failover Cluster Manager“ auf „Roles“ und selektieren aus dem Kontext-Menü „Configure Role…“

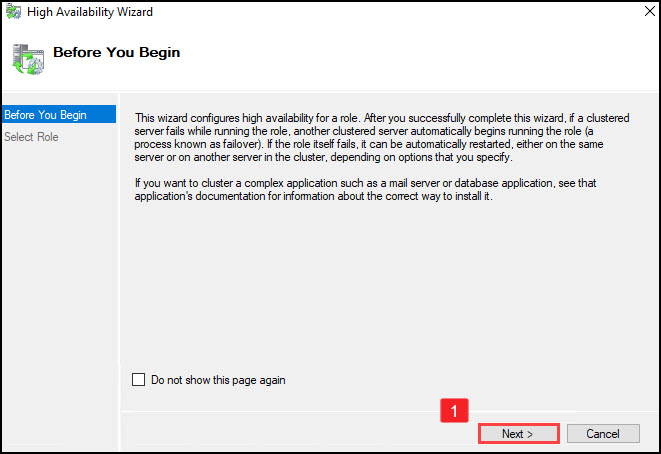

2. Klicken Sie auf „NEXT“

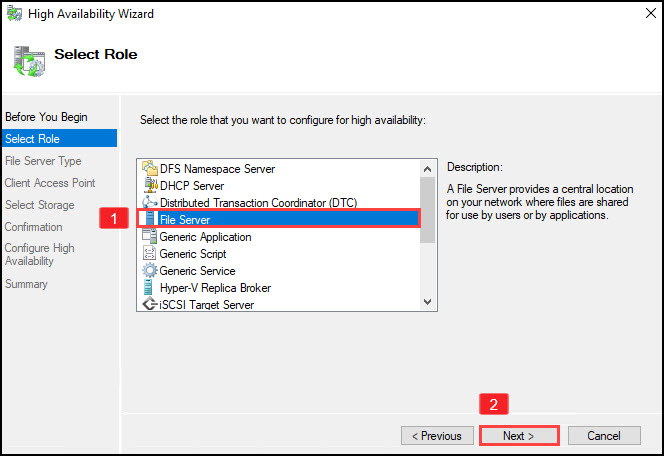

3. Selektieren Sie die Rolle „File Server“ und klicken auf „NEXT“

4. Selektieren Sie die Option „Scale-Out File Server for application data“ und klicken auf „NEXT“

5. Vergeben Sie einen NetBios Namen unter dem der SOFS für die Hyper-V Systeme später erreichbar ist und klicken im Anschluss auf „NEXT“

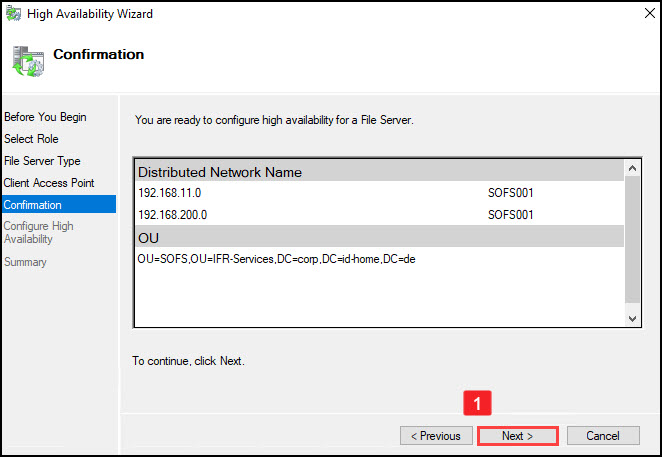

6. Ein Computer Objekt im Active Directory wird erstellt, bestätigen Sie hierzu diesen mit „NEXT“

[BoxHinweis] Es kann durchaus sein, dass diese Aktion fehlschlägt, da die SPN’s fehlen.

Legen Sie die SPN’s manuell an:

setspn -a ldap/sofs001.corp.id-home.de sofs001[/BoxHinweis]

7. Fügen Sie dem SOFS die Rolle „File Share“ hinzu (siehe Screenshot)

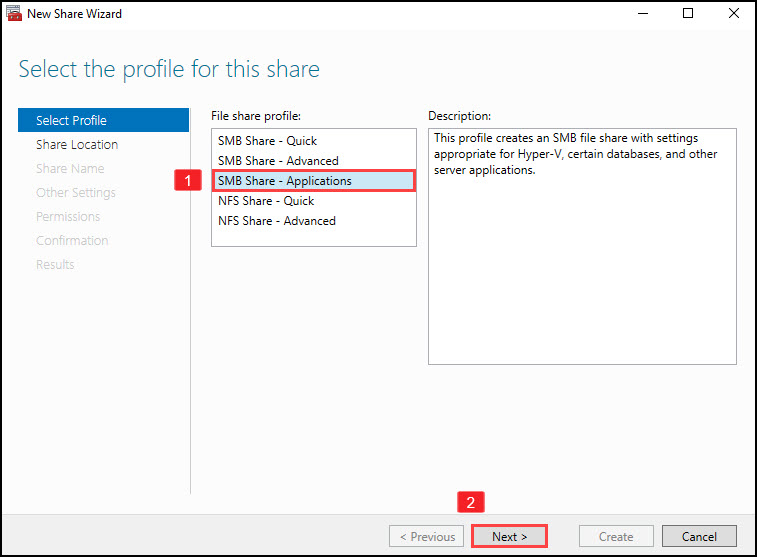

8. Selektieren Sie „SMB Share – Applications“ und klicken auf „NEXT“

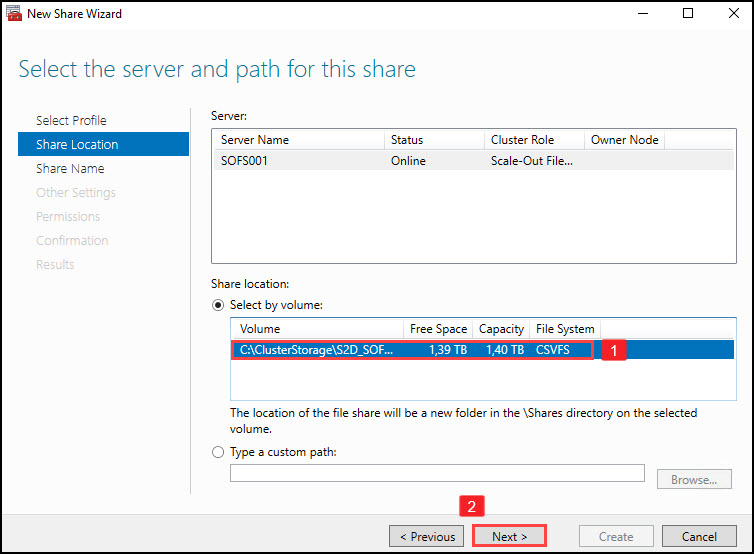

9. Geben Sie im nächsten Dialog das Volume an, auf der die Share platziert werden soll und klicken auf „NEXT“

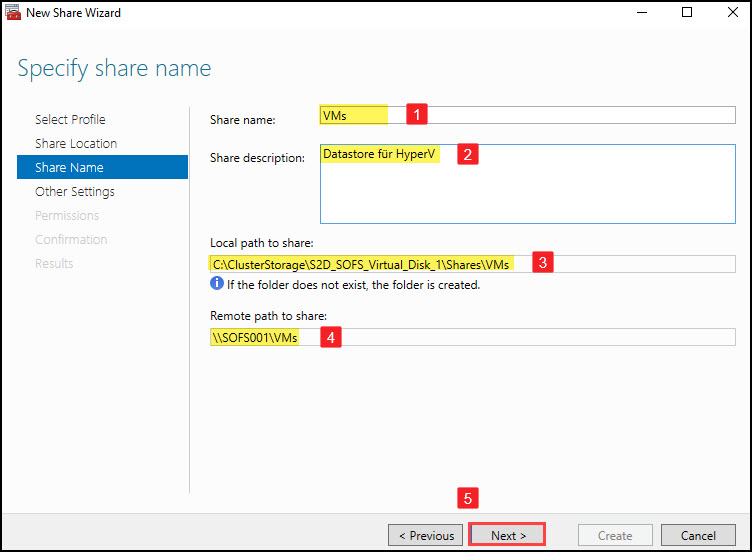

10. Vergeben Sie einen Share Namen und eine Share Beschreibung. Vergewissern Sie sich, dass der Pfad auf das „Cluster Shared Volume“ zeigt. Klicken Sie im Anschluss auf „NEXT“

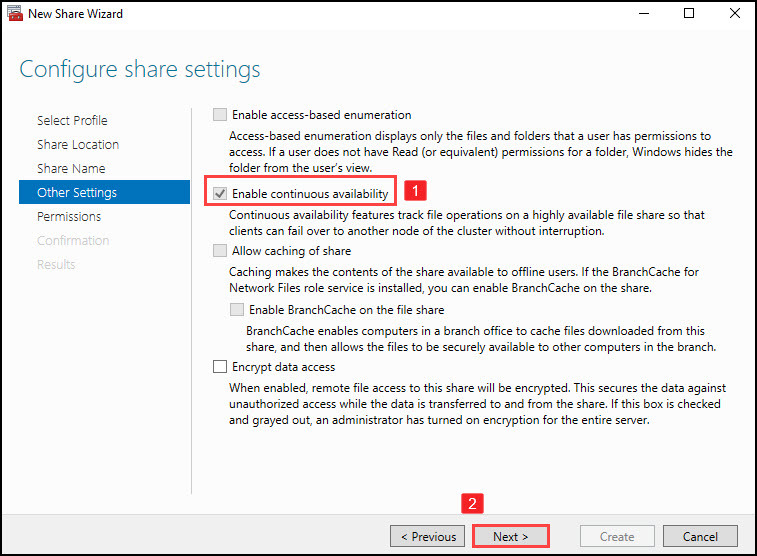

11. Selektieren Sie die Option „Enable continuous availability“ und klicken auf „NEXT“

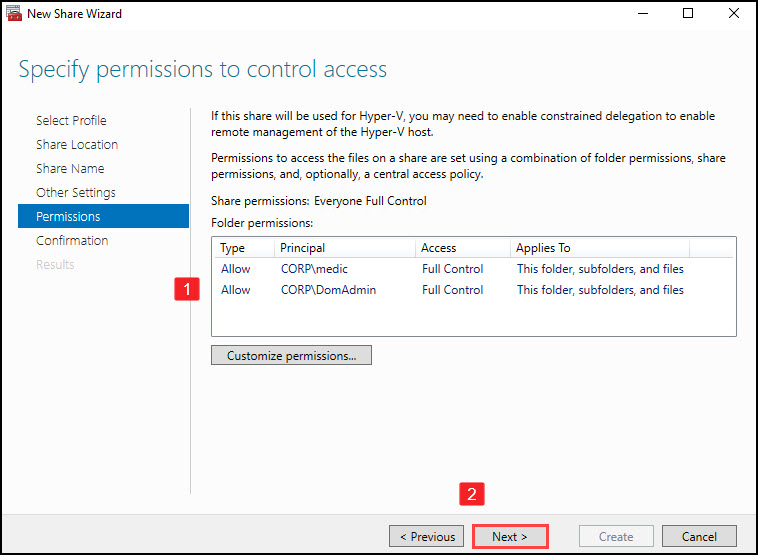

12. Vergeben Sie die passenden Berechtigungen, die Sie für den Hyper-V benötigen.

Es müssen auch unter anderem die Hyper-V Computer Objekte berechtigt werden.

Klicken Sie im Anschluss auf „NEXT“

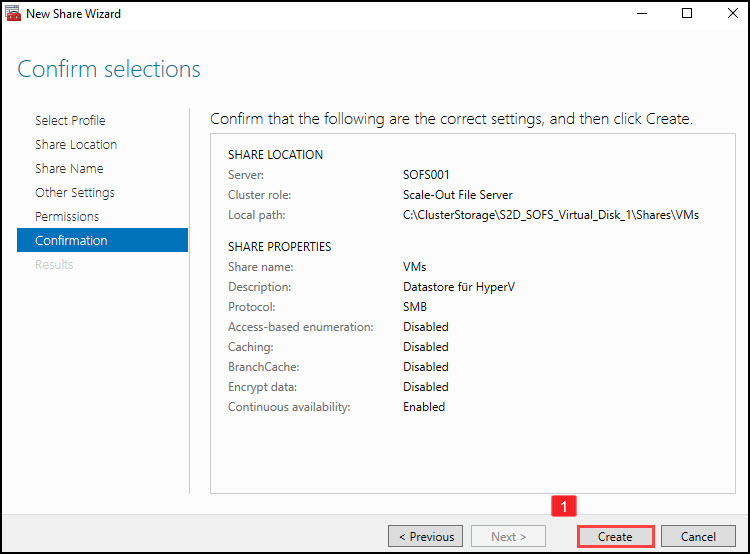

13. Bestätigen Sie den nachfolgenden Dialog mit „Create“ um die Share zu erstellen.

Die Rolle SOFS inkl. Share wurde erstellt. Konfigurieren Sie im nächsten Schritt ihren Hyper-V Cluster so, dass er auf den SOFS Datastore zeigt.

Testen des S2D und SOFS Clusters

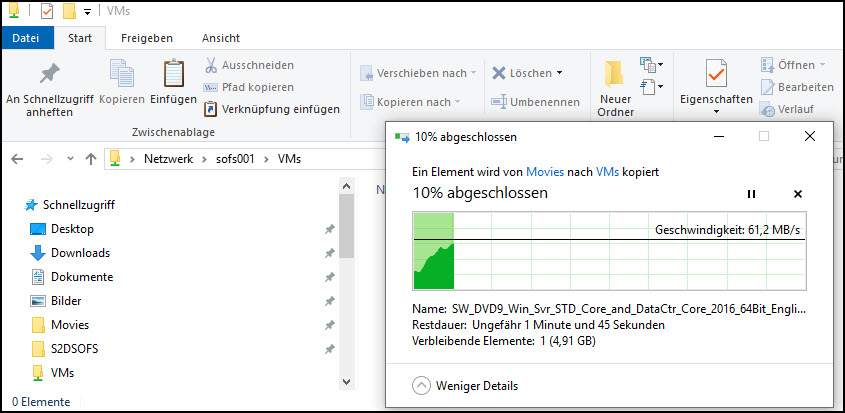

1. Im nächsten Schritt habe ich mich via UNC Pfad mit der Share verbunden und größere Dateien auf die Share kopiert um den Test durchzuführen.

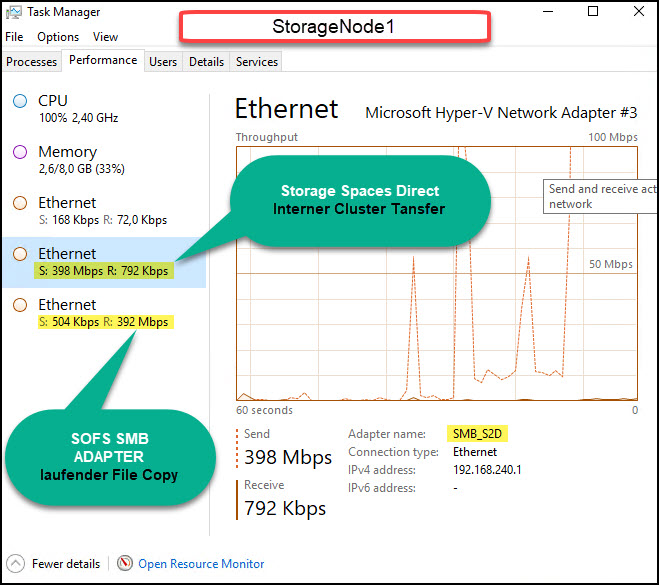

2. Auf dem „StorageNode1“ ist deutlich zu sehen, dass das Netzwerkadapter für den internen „Storage Spaces Direct Traffic“ gut ausgelastet ist. Ebenfalls ist das Netzwerkadapter für den SOFS gut ausgelastet, da über diesen Netzwerkadpater der Client Copy Job abgewickelt wird.

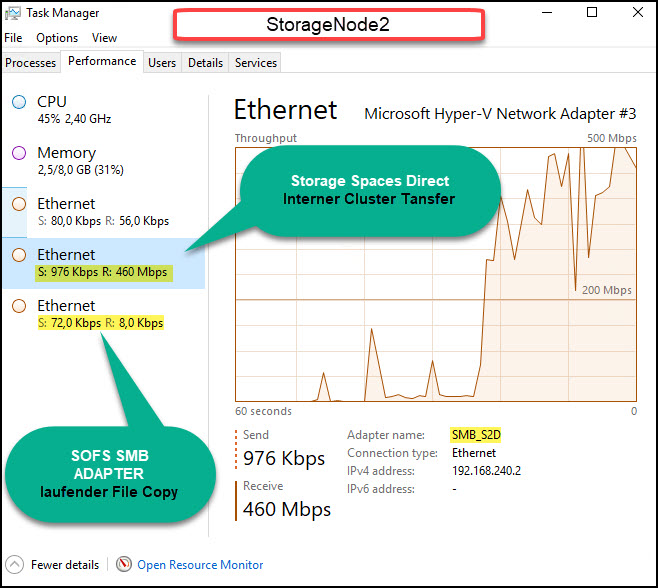

3. Fast das selbe Bild ist auch beim „StorageNode2“ erkennbar, bis auf den Unterschied, dass der SOFS Netzwerkadapter nicht beansprucht wird.

Die Konfiguration des S2D / Storage Spaces Direct Clusters ist abgeschlossen. Die Daten werden über die beiden Nodes verteilt bzw. hier ist ein Mirror hergestellt. Der Scale-Out File Server Cluster präsentiert für die Clients (Datenbanken, VMs etc.) einen hochverfügbaren Share.

Das war es mal wieder von meiner Seite, die Installation und Konfiguration ist abgeschlossen.

Ich hoffe, ich konnte Ihnen einen kleinen Einblick geben. Sollten Sie Fragen haben, so scheuen Sie nicht mich zu kontaktieren. Nutzen Sie hier die “Kommentar Funktion” des Blogs oder wenn es Ihnen lieber ist via E-Mail.

Weiter Blogs folgen in den nächsten Tagen. Ich würde mich sehr freuen, wenn Sie wieder vorbeischauen.

chris

Bei mir funktioniert es nicht. Getestet in VMWare Workstation.